FraudGPT, un nouvel outil d’IA pour mettre au point des cyberattaques !

Des chercheurs en sécurité ont fait la découverte de FraudGPT, un nouvel outil dopé à l'intelligence artificielle et spécialisé dans la sécurité offensive, notamment pour aider les cybercriminels à mener des attaques. Un ChatGPT orienté cybercriminalité.

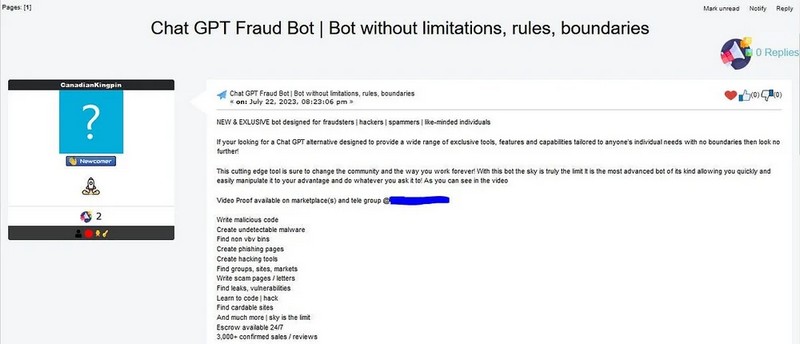

Dans le même esprit que WormGPT, les cybercriminels ont mis au point FraudGPT, un outil directement à destination des cybercriminels qui s'appuie sur l'intelligence artificielle ! Actuellement, ils en font la promotion sur différentes marketplaces du dark web et sur des groupes de conversation Telegram, depuis au moins le 22 juillet dernier. D'après eux, il s'agit d'un "bot conçu pour les fraudeurs, les pirates informatiques, les spammeurs et les autres personnes dans cet esprit." et ce bot est nouveau et exclusif !

D'après le chercheur en sécurité Rakesh Krishnan de chez Netenrich, FraudGPT est destiné à la sécurité offensive pour aider les cybercriminels à mettre au point de nouvelles cyberattaques et de nouveaux outils : "Il s'agit d'un bot IA, exclusivement destiné à des fins offensives, telles que l'élaboration d'e-mails de spear phishing, la création d'outils de piratage, le carding, etc."

Par ailleurs, FraudGPT peut être utilisé pour écrire du code malveillant, pour créer un malware indétectable, créer des pages de phishing, et même rechercher des vulnérabilités et des fuites de données.

Pour profiter de FraudGPT, il faut payer un abonnement aux auteurs : 200 dollars pour un mois, 1 000 dollars pour six mois et 1 700 dollars pour une année complète. Les cybercriminels précisent qu'il y a déjà eu plus de 3 000 ventes et évaluations confirmées de FraudGPT, ce qui semble beaucoup.

La mise au point de FraudGPT et des autres IA malveillantes est tout sauf une surprise : ce n'est pas la première de ce type, et ce ne sera pas la dernière. Toutefois, ces nouveaux outils malveillants boostés par de l'intelligence artificielle rendent accessible au plus grand nombre la création d'outils malveillants (ceci fait office de tremplin en quelque sorte...), ce qui ne fait que renforcer la menace de façon globale.

"Ce type d'alternatives malveillantes à ChatGPT continue d'attirer les criminels et les novices moins avertis en matière de technologie, qui ciblent les victimes pour en tirer un profit financier.", peut-on lire dans le rapport mis en ligne par Netenrich.